一、大数据概念:超越海量的多维价值

大数据并非单纯指数据量的庞大,而是指在规模(Volume)、速度(Velocity)、多样性(Variety)、价值(Value)和真实性(Veracity)这五个维度上超出传统数据处理能力范围的数据集合。其核心在于通过对海量、多源、实时或非结构化的数据进行采集、存储、处理与分析,挖掘出新的知识、洞察和决策支持,驱动业务创新与效率提升。典型的大数据技术生态包括Hadoop、Spark、Flink等分布式计算框架,它们构成了处理大数据的基石。

二、大数据处理的核心挑战:Shuffle及其调优

在大规模分布式计算(如Spark、MapReduce)中,Shuffle(洗牌)是连接不同计算阶段的关键环节,指将数据按需重新分区和跨节点传输的过程。它是性能瓶颈的主要来源,不当的Shuffle会导致严重的磁盘I/O、网络拥堵与内存压力。

Shuffle调优的关键方向包括:

1. 减少数据量:在Map端通过combine(合并)或使用更高效的数据结构(如Bloom Filter)预先聚合,减少需要传输的数据。

2. 优化分区策略:避免数据倾斜,通过自定义Partitioner或使用salting(加盐)技术,使数据在Reduce端均匀分布。

3. 调整缓冲区与压缩:增大spark.shuffle.file.buffer(Spark)或mapreduce.task.io.sort.mb(Hadoop)等缓冲区大小,减少磁盘溢写次数;启用中间数据压缩(如Snappy、LZ4)以降低网络和磁盘I/O开销。

4. 选择高效的Shuffle机制:例如在Spark中,根据场景在sort、hash或tungsten-sort等Shuffle管理器间选择。

三、系统级参数调优:释放集群潜力

参数调优旨在根据数据特征、集群规模和硬件配置,精细化调整系统行为,以平衡资源利用、稳定性和性能。

重点调优领域:

1. 内存管理:合理设置Executor/Container的内存分配,划分给堆内存、堆外内存(Off-Heap)以及Shuffle、缓存等特定用途的比例(如Spark的spark.memory.fraction)。避免频繁的GC或OOM错误。

2. 并行度与资源分配:设置合适的任务并行度(如Spark的spark.default.parallelism),使其与集群核心数匹配,避免资源闲置或过度竞争。动态资源分配(如Spark Dynamic Allocation)可根据负载自动调整资源。

3. 容错与稳定性:调整心跳超时、最大任务失败次数等参数,提高作业在节点故障或网络波动下的鲁棒性。

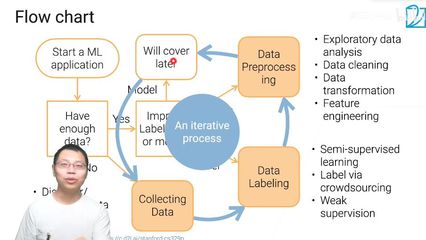

调优是一个迭代过程,需结合监控指标(GC时间、Shuffle读写量、任务执行时间分布等)持续分析与验证。

四、大数据储存服务:持久化的基石

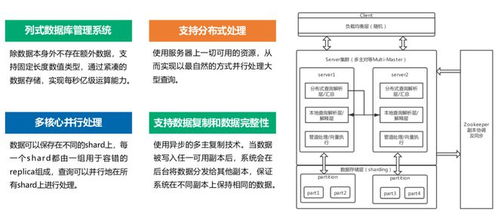

大数据储存服务负责数据的可靠、高效、可扩展存储,是上层计算与分析的前提。其演进从经典的分布式文件系统(如HDFS)扩展到对象存储、NoSQL数据库及云原生存储服务。

主流储存方案与考量:

1. HDFS:适合大文件、高吞吐的顺序读写场景,为Hadoop生态的核心。调优关注块大小、副本因子、机架感知及NameNode高可用。

2. 对象存储(如S3、OSS、OBS):具有无限扩展性、高耐用性和低成本,常用于数据湖架构。需注意其最终一致性模型及与计算引擎(如Spark)的集成性能(可能需缓存层加速)。

3. NoSQL数据库(如HBase、Cassandra):提供低延迟的随机读写,适用于实时查询。需根据访问模式设计行键、列族等。

4. 云原生与湖仓一体:如Delta Lake、Iceberg等表格格式,在对象存储之上提供ACID事务、模式演进等能力,构建统一的数据管理平台。

储存服务的选择需综合考量数据访问模式(批处理/实时)、成本、一致性要求及与计算框架的集成度。

五、

大数据处理是一个系统工程。深入理解其核心概念是基础,而性能优化则需聚焦于Shuffle这一关键路径,并结合系统级参数进行精细调控。选择与场景匹配的储存服务,为数据全生命周期提供稳固高效的支撑。唯有将计算、存储与资源管理协同优化,才能充分发挥大数据技术的价值,应对日益复杂的业务挑战。